Petite visite à la conférence française NAFEMS, qui se tenait à Paris les 14 et 15 novembre derniers. L’occasion de faire le point sur le monde de la simulation numérique.

Jean-Marc Crepel, responsable du comité de programme, a ouvert la session 2018 de la Conférence NAFEMS France en se félicitant de la qualité des 80 présentations d’utilisateurs ou axes de recherche qui ont rythmé ces deux journées, de l’audience grandissante (240 inscrits) et de la représentativité de l’exposition avec une vingtaine de sociétés participantes. « Parmi les nouveautés de cette édition, notons une table ronde sur les besoins des utilisateurs en termes d’informatique haute performance (HPC), la présentation du Forum SPDM sur la Gestion des processus et des données de simulation, la session sur la simulation dans le domaine biomédical qui peut donner des idées à de nombreux industriels. »

| Les objectifs de NAFEMS

NAFEMS est une organisation mondiale, neutre, indépendante et sans finalité commerciale ayant pour vocation de tisser des liens d’ordre scientifique et technique entre ingénieurs, chercheurs et spécialistes des questions de simulation numérique, afin de diffuser les connaissances et les meilleures pratiques. Elle regroupe aujourd’hui 1 400 membres dans 43 pays. |

Tim Morris, CEO de NAFEMS a quant à lui rappelé les objectifs de l’association (1 400 membres dans le monde, 90 en France) dans le domaine de la simulation numérique, qui visent à améliorer son usage. « Cela passe par : l’organisation de sept manifestations qui rassemblent plus de 600 participants ; de la formation ; la publication d’ouvrages de référence ; la mise en place d’une certification Professional Simulation Engineer (PSE)… »

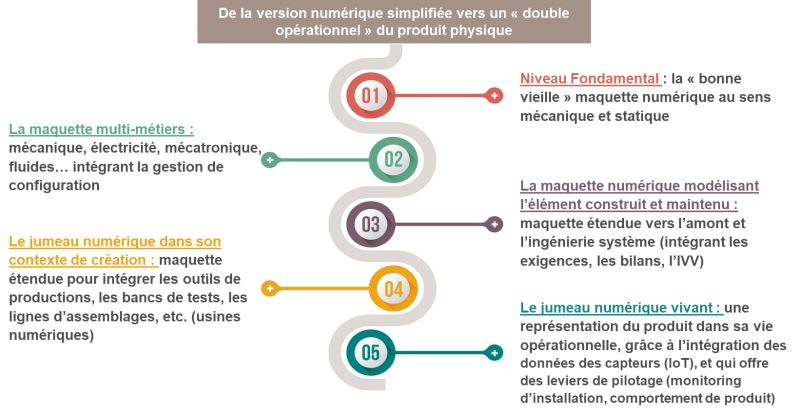

Les cinq vies du jumeau numérique

Lors de la première session plénière Denis Debaecker, Partner du cabinet de conseil en performance opérationnelle Mews, a dressé un panorama complet du concept de jumeau numérique et de son intérêt dans le monde de la simulation numérique. « La mise en place du jumeau numérique a des impacts graduels dans l’entreprise selon que l’on parle d’une simple maquette mécanique telle que conçue, ou du niveau 5 allant jusqu’au comportement en contexte du produit. » (Voir illustration)

« Dès le niveau multi-discipline, multi-étapes du cycle de vie, de très nombreux acteurs sont concernés. Autant de difficultés pour s’entendre. Autant également de gains en continuité numérique, en cohérence. Autant de capacités nouvelles pour prédire et améliorer le produit », explique-t-il.

Il a aussi insisté sur les compétences requises pour la mise en œuvre du jumeau numérique, qui nécessite de rapprocher des acteurs qualifiés du digital (IoT, analytics) et les représentants métier. Enfin, il a terminé son exposé en ouvrant sur des perspectives d’avenir : « Les capacités de l’intelligence artificielle pour optimiser la conception à partir des données d’usage et d’ingénierie (simulation, essais…) sont des perspectives ‘‘différenciantes’’ qui militent vivement pour, pas à pas, faire vivre et grandir son jumeau numérique. »

Il n’y aura pas de véhicule autonome sans simulation numérique

C’est ce qu’est venu expliquer Olivier Colmard, Integrated CAE & PLM, Engineering VP du Groupe Renault. « Le véhicule autonome présente un intérêt certain ne serait-ce que par le fait que 90 % des accidents sont dus à des erreurs humaines ou que chaque conducteur passe en moyenne en Ile-de-France 78 minutes par jour derrière son volant ».

Après avoir présenté les 5 niveaux possibles d’assistance à la conduite, et les domaines technologiques mis en jeu (capteurs, connaissances, prise de décision, actionneurs), il a expliqué qu’il faudrait beaucoup de redondances dans les capteurs, la navigation, les actionneurs pour la direction et les freins, les processeurs et les architectures informatiques embarquées, ainsi que pour les systèmes de propulsion (thermique, électrique, hybride…). « Mais outre la fiabilité de ces équipements, la mise en place de nouvelles réglementations, l’adaptation des infrastructures et la formation des conducteurs, le plus grand défi sera dans l’acceptation sociale de cette nouvelle technologie. »

Cela passera par une validation rigoureuse de toutes les technologies mises en œuvre via des organismes certificateurs, mais aussi par un recours massif à la simulation numérique. « Pour que nos véhicules soient bien acceptés, il faudra que le taux d’accident mortel par heure de conduite soit inférieur à 10-8, alors qu’il est actuellement dans l’OCDE de 10-6 tous types de routes confondus et 10-7 sur les seules autoroutes. Pour garantir ce niveau, il faudrait réaliser 15 milliards de kilomètres d’essais routiers pour valider tous les cas de figure, ce qui est matériellement impossible. C’est pourquoi la simulation numérique va nous être d’un grand secours ».

La chaine de simulation qui se met en place chez Renault comporte 3 étapes. La première est la définition d’un catalogue de scénarios élémentaires de conduite issus de professionnels, d’une base d’accidentologie et d’essais routiers. Ces scénarios élémentaires seront ensuite agrégés par une ‘‘Scenario Factory’’ dans des scénarios de conduite qui, combinés au modèle comportemental numérique d’un véhicule avec ses capteurs, alimenteront une plate-forme de simulation massive (60 à 80 000 cœurs) ou des simulateurs de conduite, pour mettre un vrai conducteur dans la boucle. Les résultats, des milliards de km virtuels, seront ensuite analysés grâce à des outils de Big Data et d’Intelligence Artificielle.

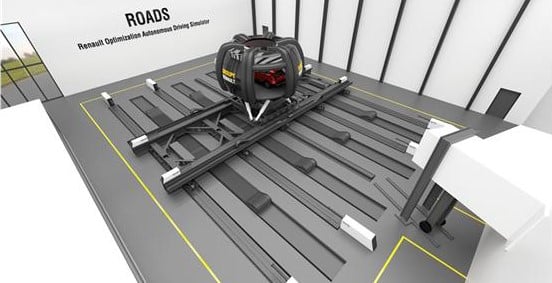

Notons que Renault est entrain de construire au sein de son Technocentre de Guyancourt, un nouveau simulateur de conduite très performant, Roads (Renault Optimization Autonomous Driving Simulator), représentant un investissement de 30 M€. Il s’agit d’un poste de conduite réel enfermé dans une bulle disposant d’écrans UHD sur 360°. Cette bulle est placée sur un système lui offrant 9 degrés de liberté. Ce système étant lui-même placé sur une table XY ayant des courses de 15 mètres. On peut ainsi atteindre des accélérations de 1g sur tous les axes. On voit que Renault entend bien jouer la complémentarité entre simulation numérique, simulation de conduite et essais routiers.

Les méta-modèles multi-fidélités en calcul de structures

Les méta-modèles ou modèles de substitution sont aujourd’hui très répandus, car ils apportent une solution intéressante à la problématique des coûts des simulations numériques inhérents aux problèmes d’optimisation, d’analyse de sensibilité, d’exploration d’un espace de conception…

« Ces modèles de substitution multi-fidélité, que ce soit dans le cadre de l’optimisation ou de la création d’un ‘‘abaque virtuel’’, constituent une réponse intéressante qui sait utiliser tous les niveaux de modélisation (modèles analytiques ou numériques simples, modèles éléments finis linéaires et non-linéaires), voire même résultats expérimentaux », explique Pierre-Alain Boucard, professeur au Département Génie Mécanique/LMT/ENS Cachan/CNRS/Université Paris-Saclay.

Il a notamment montré comment on peut étendre ces méta-modèles, en particulier ceux basés sur le ‘‘krigeage’’ ou plus largement sur les processus gaussiens, à l’utilisation de plusieurs simulations de niveaux de fidélité différents. Il a illustré le fonctionnement de ces méthodes sur des cas simples, puis montré sur quelques cas plus complexes leur utilisation en couplage avec des simulations numériques en calcul de structures à différents niveaux de fidélité.

« Les niveaux de fidélité différents illustrés ici correspondent à des modèles réduits plus ou moins complets associés à des simulations non linéaires (assemblages avec contact frottant, calcul en viscoplasticité…), mais ce cas particulier de couplage méta-modèles multi-fidélité/modèles réduits n’enlève rien à la généralité de la démarche. La construction d’un méta-modèle multi-fidélité fait en effet appel à différents ‘‘modules’’ indépendants des codes de simulation permettant leur utilisation dans une large variété d’environnements », explique-t-il.

HPC : l’avenir de la simulation

Enfin la table ronde sur les attentes des utilisateurs du calcul haute performance (HPC) a permis de dégager quelques points qui font consensus :

- Avant tout, il faut bien définir ses objectifs en suivant l’évolution des performances et des prix ;

- Il faut trouver le bon compromis temps/performance pour arriver à une prise de décision rapide ;

- Le HPC facilite l’analyse multi-échelles ;

- Il faut partager un vocabulaire et des métriques communes entre les utilisateurs et les services informatiques ;

- La collaboration Open source aide à affronter les difficultés de développement (architecture, algorithmes et algèbre linéaire…) ;

- Les recherches sur le calcul quantique font progresser l’environnement HPC actuel, même si les limites entre technologies actuelles et quantiques restent à préciser ;

- Il faut assurer une bonne gestion de la conduite du changement ;

- Enfin, la sécurité des données reste un vrai problème qu’il faut bien comprendre et bien évaluer.

Je ne rentrerai pas dans le détail des 80 autres présentations qui sont en grande partie disponibles sur le site de NAFEMS France, mais on voit bien à travers ce résumé que la simulation est l’avenir de la conception et de l’innovation.

Jean-François Prevéraud

Pour en savoir plus : www.nafems.org/2018/france/presentations/