En se basant sur des recherches menées à l’Institut de la Vision depuis plus de 20 ans, Prophesee a développé un capteur de vision qui clone le fonctionnement de l’œil humain. Celui-ci, uniquement déclenché par les changements intervenant dans une scène, fonctionne en mode analogique. Il est donc beaucoup plus efficace et rapide que les systèmes de vision classique basés sur l’analyse d’images séquencées, tout en générant moins de données à traiter.

| Frame-Based vs Event-Based

Frame-Based : Une caméra conventionnelle prend un nombre arbitraire d’images par seconde, généralement autour de 30, dans lequel l’ensemble du réseau de capteurs est déclenché à un rythme prédéfini, quelle que soit la dynamique de la scène réelle. Cela conduit à l’acquisition de gros volumes de données brutes, sous-échantillonnées ou redondantes. Event-Based : Dans le capteur breveté Metavision de Prophesee, il existe un nouveau type de pixel. Chacun d’eux est alimenté par son propre traitement intelligent indépendant. Cela leur permet de n’enregistrer une information que lorsqu’ils détectent un changement ou un mouvement dans la scène. Les informations créées n’arrivent pas image par image. Au contraire, le mouvement est capturé comme un flux continu d’informations. Ainsi il voit en permanence là où les systèmes de vision traditionnels, basés sur les images, sont aveugles.

|

Le Consumer Electronics Show (CES 2023), salon international dédié aux nouvelles technologies, qui s’est tenu à Las Vegas début janvier, a été l’occasion de découvrir les dernières innovations en matière de high-tech. Nombre de start-up françaises y ont participé, dont une quinzaine issues des laboratoires sous tutelle CNRS. Parmi elles, nous avons remarqué l’entreprise parisienne Prophesee, qui développe un des systèmes de vision neuro-morphique les plus avancés au monde.

Inspirée de la vision humaine, la technologie de Prophesee, issue des recherches de pointe menées par l’Institut de la Vision (CNRS, UPMC, INSERM) sur le cerveau et l’œil depuis plus de 20 ans, utilise une conception de capteur brevetée et des algorithmes d’intelligence artificielle, qui imitent l’œil et le cerveau pour révéler ce qui était invisible jusqu’à présent en utilisant des systèmes de vision classiques basés sur les images. Prophesee appelle cela l’Event-Based Vision, ou vision basée sur les événements.

Luca Verre, Co-fondateur et CEO de Prophesee, nous en explique le principe. « L’œil est un capteur biologique utilisant la lumière pour aider l’homme à prendre des décisions face à des changements intervenant dans son environnement. La lumière, c’est des photons qui se réfléchissent sur des objets, lesquels photons sont capturés par la rétine de l’œil. Celle-ci est bardée de photorécepteurs, les cônes et les bâtonnets, qui absorbent les photons et acquièrent ainsi l’information de manière asynchrone, c’est à dire au fur et à mesure que la lumière arrive sur la rétine. Les photons sont ainsi transformés en signaux électro-chimiques et transmis par les nerfs optiques au cortex, qui est la partie du cerveau qui traite ces signaux électriques. C’est ce fonctionnement que nous reproduisons avec notre système de vision, qui ne fait pas une acquisition synchrone de l’information, image après image à fréquence régulière, mais une acquisition asynchrone basée sur les changements dans la scène observée. »

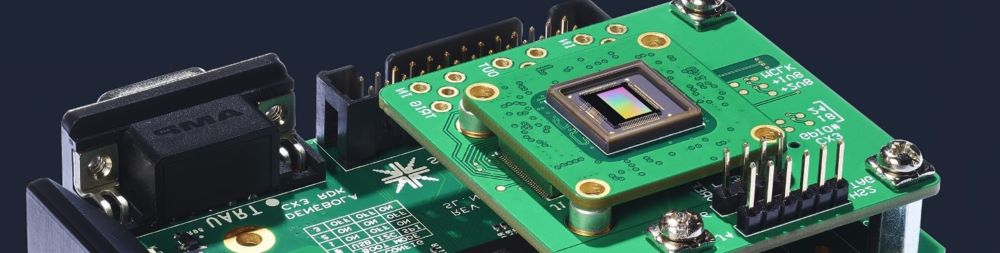

Un capteur qui clone la rétine

Pour cela le capteur Metavision, que Prophesee a mis au point, comporte des pixels, qui comme les cônes et batônnets fonctionnent de manière indépendante et asynchrone. Chaque pixel ne réagit que s’il y a des changements dans la portion de scène qu’il observe. De fait, il ne capte que la dynamique d’une scène (mouvement, changement de contraste…) pour générer des informations. Toutes les parties statiques de la scène ne sont plus récupérées en permanence. « Cela permet de réduire le volume d’informations à traiter d’un facteur 10 à 100. Tout se fait de manière analogique, avec des précisions temporelles de l’ordre de la micro seconde, donc c’est comme si on avait une caméra qui fonctionnait à 10 000 ou 100 000 images par seconde, donc 10 à 100 fois plus rapide qu’une caméra traditionnelle. »

Ainsi quelque chose se déplaçant à grande vitesse sera échantillonné à un taux élevé, alors que quelque chose qui se déplace lentement sera échantillonné à un taux inférieur, et que quelque chose qui ne change pas, ne sera pas échantillonné du tout. Aucune donnée excédentaire n’est donc créée. Cela réduit considérablement les exigences en termes de puissance, de latence et de traitement des données imposées par les systèmes traditionnels basés sur des images.

Des logiciels de traitement adaptés et de multiples applications

Même si le volume de données à traiter est moins important que dans les systèmes de vision basés sur des images, il faut quand même en assurer le traitement. Pour cela, Prophesee a développé la Metavision Intelligence Suite. Cette boite à outils logicielle Open Source comporte 95 algorithmes, 67 exemples de code et 11 applications prêtes à l’emploi pour faciliter l’intégration de la technologie Event-Based Vision chez les clients voulant l’intégrer dans leurs produits.

Une technologie qui réduit la quantité de données ne pouvait que séduire de multiples secteurs. « On l’utilise par exemple dans l’industrie pour détecter des vibrations d’objets ou de machines, dont les changements de fréquence et d’amplitude sont souvent les signes avant-coureurs de possibles pannes. On arrive à détecter des très faibles fréquences, de l’ordre de quelques hertz, jusqu’à quelques dizaines de kilohertz. »

Toujours dans la domaine manufacturier, cette technologie trouve des applications dans le contrôle qualité et l’inspection pour faire de la détection et du comptage de produits défilant à grande cadence. « On est ainsi implanté dans des usines pharmaceutiques sur des lignes de production de pilules ou dans agroalimentaire sur des lignes utilisant des grains de blé ou de riz. »

L’industrie automobile n’est pas en reste. « Nous y travaillons pour des applications de sécurité embarquée. Une caméra tournée avant du véhicule, équipée de notre capteur, détecte tous les objets en mouvement dans son champ de vision (piétons, cyclistes, autres véhicules…) pour détecter tous les risques de collision, afin de les éviter. »

Le médical est aussi intéressé. « Nous avons un partenariat avec Pixium Vision, qui développe un dispositif médical avec un implant rétinien pour permettre à des personnes qui ont des dégénérescences la rétine de pouvoir récupérer une partie de la vue. Et c’est là, en fait, que le modèle du biomimétisme, basé l’être humain, permet d’être très efficace et très performant », conclut Luca Verre.

Jean-François Prevéraud

Pour en savoir plus : https://www.prophesee.ai